MIT CSAIL

MADRID, 18 Jun. (Portaltic/EP) -

Una algoritmo de Inteligencia Artificial desarrollado por el Instituto Tecnológico de Massachusetts (MIT), en Estados Unidos, ha sido capaz de reconstruir el aspecto del rostro de una persona tomando como punto de partida únicamente su voz.

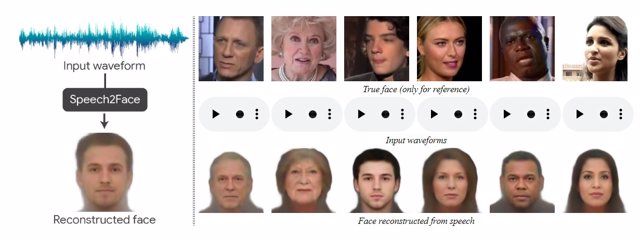

El laboratorio de Ciencias Informáticas e Inteligencia Artificial del MIT (MIT CSAIL) ha publicado Speech2Face ('de habla a cara', en inglés), una herramienta que a través de un extracto breve de habla es capaz de determinar factores como la edad, el género y la etnia de una persona.

Los autores del estudio han asegurado que su objetivo "no es reconstruir una imagen precisa de la persona, sino más bien recuperar características físicas que están correlacionadas con el habla".

Este proyecto busca saber hasta qué punto es posible saber el aspecto de una persona a partir de su voz, y se inspira en la manera en que las personas construimos modelos de los rasgos de alguien de quien solamente conocemos su voz.

Speech2Face funciona a través de una red neuronal de aprendizaje profundo diseñada y entrenada a partir de la base de datos abierta AVSpeech, compuesta por más de 100.000 personas hablando en fragmentos cortos de seis segundos.

Para demostrar sus resultados, la investigación ha utilizado también la base de datos VoxCeleb, formada por millones de vídeos publicados en Internet en los que aparecen 7.000 personas famosas en entrevistas, en fragmentos cortos de al menos tres segundos.

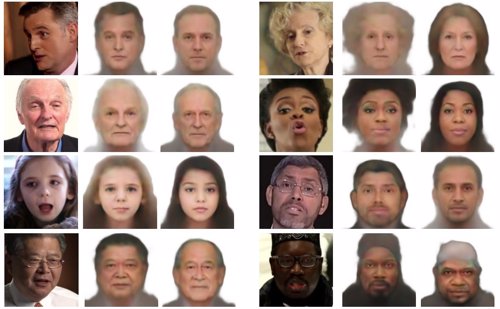

La imagen generada es la del rostro de una persona de frente, con gesto neutro, y se han expuesto junto a imágenes reales de los famosos en los vídeos para mostrar el parecido con el original.

Durante el entrenamiento, el modelo del estudio aprende de los vídeos de la base de datos correlaciones de audio y sonido entre las voces de las personas y sus caras, centrándose en atributos físicos como la edad, el género y la etnia, pero añadiendo también otros como varias medidas y proporciones craneofaciales.

El funcionamiento de Speech2Face tiene lugar de manera no supervisada, haciendo uso solamente de las relaciones entre habla y aspecto observadas en los vídeos.

RESULTADOS Y PRECISIÓN

Posteriormente, los autores del estudio han analizado las correlaciones estadísticas que existen entre los rasgos faciales y las voces, con un 94 por ciento de precisión a la hora de determinar el género.

Los resultados a la hora de identificar a personas de etnias blancas y asiáticas han sido buenos, según los investigadores, pero no tanto en los casos de personas de raza negra o de India, posiblemente debido a su menor presencia en las bases de datos.

En el caso de los atributos craneofaciales, el mayor índice de correlación con el habla y el aspecto se ha encontrado en la nariz y en la boca, resultados indicativos de que "la estructura de la nariz determina el habla".